-

随着科技的发展,鸟类图像的大量采集变得更加便捷,可利用图像采集设备(如红外相机[1]、普通相机)采集,也可利用智能手机采集。随着鸟类数据共享平台(eBird[2]、中国爱鸟网等)的建立,来自世界各地的大量鸟类图像数据被上传至网络数据库。仅以eBird为例,已有超过2 000万张鸟类图像被上传至该平台,并且图像数量依旧在迅速增长。鸟类图像记录了鸟类形态学特征、生境信息[3]及行为学特征,对鸟类学研究有着重要的价值,但面对如此大量的鸟类图像数据,仅凭人工处理是无法满足需求的。为了能快速自动化处理大量的鸟类图像数据,深度学习(Deep Learning)领域的研究人员已经开展了相关研究。图像识别技术应用于鸟类物种识别已有一些成功案例,在标准鸟类图像数据库CUB200-2011[4]的技术报告中,Welinder等[4]就使用局部区域和基于传统特征的词包模型实现分类,Berg等[5]提出POOF特征,Yao[6]和Yang[7] 等均尝试使用模板匹配的方法替换定位算法中的滑动窗口,以降低算法复杂度。基于图像识别技术的珍稀濒危鸟类的行为识别具有重大应用价值[8],但整体看来,目前的研究主要涉及计数[9]、密度估计[10]、生境因素识别[11]等。虽然目前自动监测获得的影像数据量极大,其中很大一部分行为表达数据对于无人为干扰下鸟类行为的研究很有价值,但是目前使用这种方式对野生鸟类行为学进行的研究少之又少。动物通常以身体运动和身体姿势来表达行为,动物的行为是其对环境和生理状况的一种反应,为研究动物健康水平提供了重要的线索[12],所以进行动物行为识别或动作识别是十分必要的。

卷积神经网络(Convolutional Neural Networks, CNN)为深度学习的代表算法之一,其在图像识别领域展现了非常大的潜力和极佳的性能[13-15]。经典的神经网络模型包括ResNet[16]、VGG Net[17]、ALexNet[18]、GoogLeNet[19]等,其中,残差网络(Residual Network, ResNet)良好地解决了网络加深带来的学习退化问题,该模型目前在各领域取得了广泛应用[20]。目前利用卷积神经网络来实现野生动物自动识别的研究较多。史春妹等[21]运用单次多盒目标检测方法来进行东北虎的个体识别,达到97.4%的准确率。石鑫鑫等[22]提出了一种全连接算法与稀疏连接算法相结合的全卷积神经网络解决了蛙声识别问题,准确率达到99.67%。还有使用基于感兴趣区域与卷积神经网络的野生动物物种自动识别方法实现了基于野生动物监测图像的物种识别研究,平均识别率均可达到90%左右[23]。残差网络模型的应用研究成果对于鸟类图像大数据的有效利用有着重要的辅助作用,但仍不能满足实际需要,仍缺乏应用卷积神经网络进行野生鸟类的动作自动化识别研究[24]。

勺嘴鹬隶属鹬科(Scolopacidae)滨鹬属(Calidris), 是一种仅分布于东亚–澳大利西亚候鸟迁徙路线上的涉禽[25],被世界自然保护联盟(IUCN)红色名录列为极度濒危(CR)物种。其在我国的江苏、浙江、福建、广东、海南等省份均有被记录到,其中,海南儋州湾是海南岛目前已知的为数不多的勺嘴鹬的为数不多的越冬地。繁殖期以外的时期,勺嘴鹬只在滨海滩涂湿地有分布,觅食地主要为潮间带的滩涂[26]。目前,国内外主要利用环志等回收数据,开展勺嘴鹬的栖息地保护[27]、种群数量[28]和分布区系[29]等的研究,未涉及其行为动作的识别。因此,笔者尝试使用卷积神经网络模型(ResNet50、ResNet101和ResNet152)进行勺嘴鹬动作的自动识别研究,以期开启海南热带地区鸻鹬类[30]涉禽的动作识别以及其他野生鸟类行为学自动识别的研究。

-

儋州湾(109°02′~109°36′E,19°33′~20°01′N)位于海南省儋州市中北部,由北部湾伸入洋浦半岛进而形成的半封闭内湾, 面积约为 50 km2。该区域属于季风性气候,冬季干燥、夏季湿润,年平均降雨量约1 426 mm,年均气温23.1 ℃[31]。儋州湾于1986年被设立为市级自然保护区,红树林面积约133 hm2,是黑脸琵鹭(Platalea minor)、小青脚鹬(Tringa guttifer)、勺嘴鹬等珍稀濒危迁徙涉禽的重要越冬地和停歇地[32]。

-

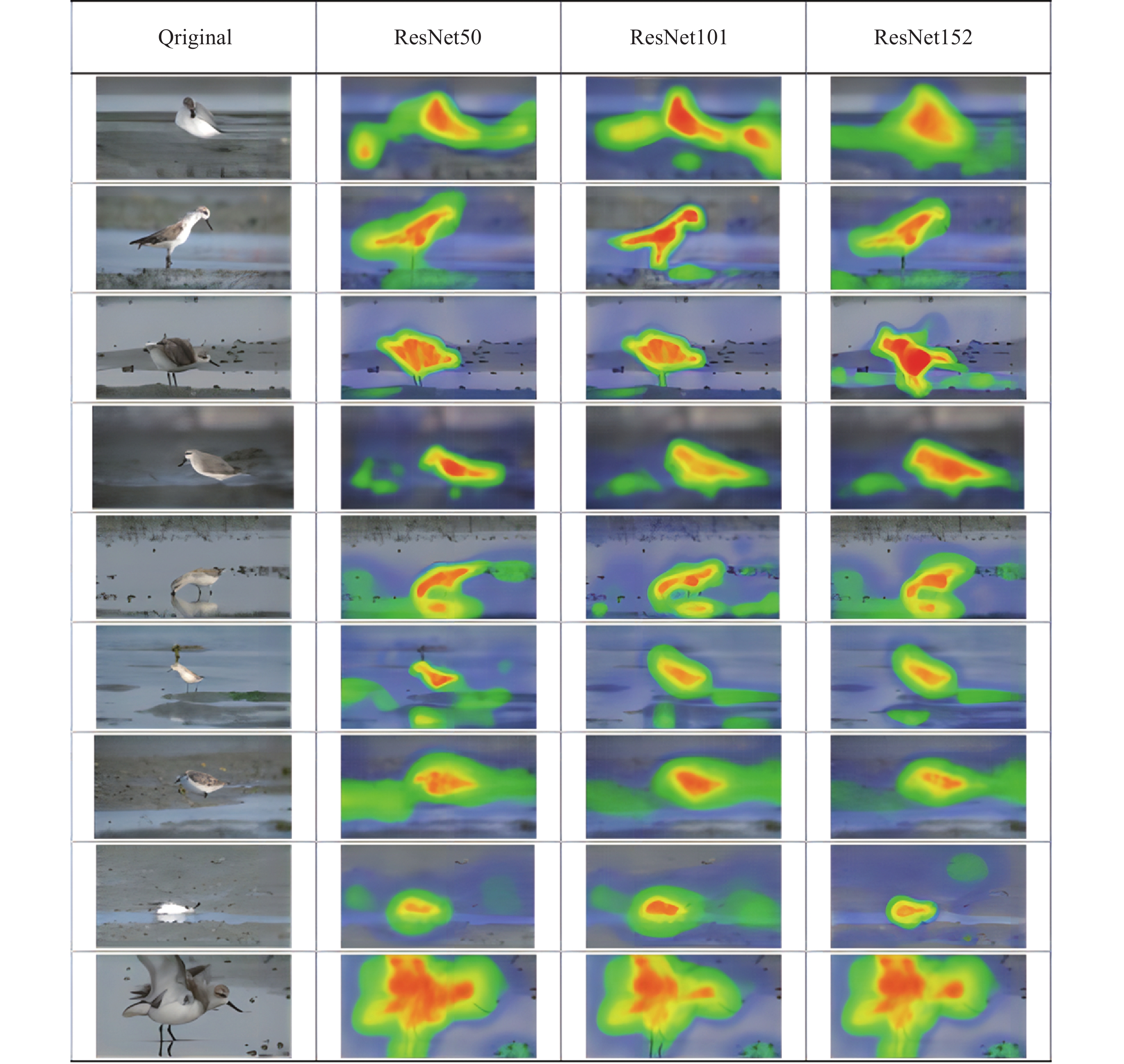

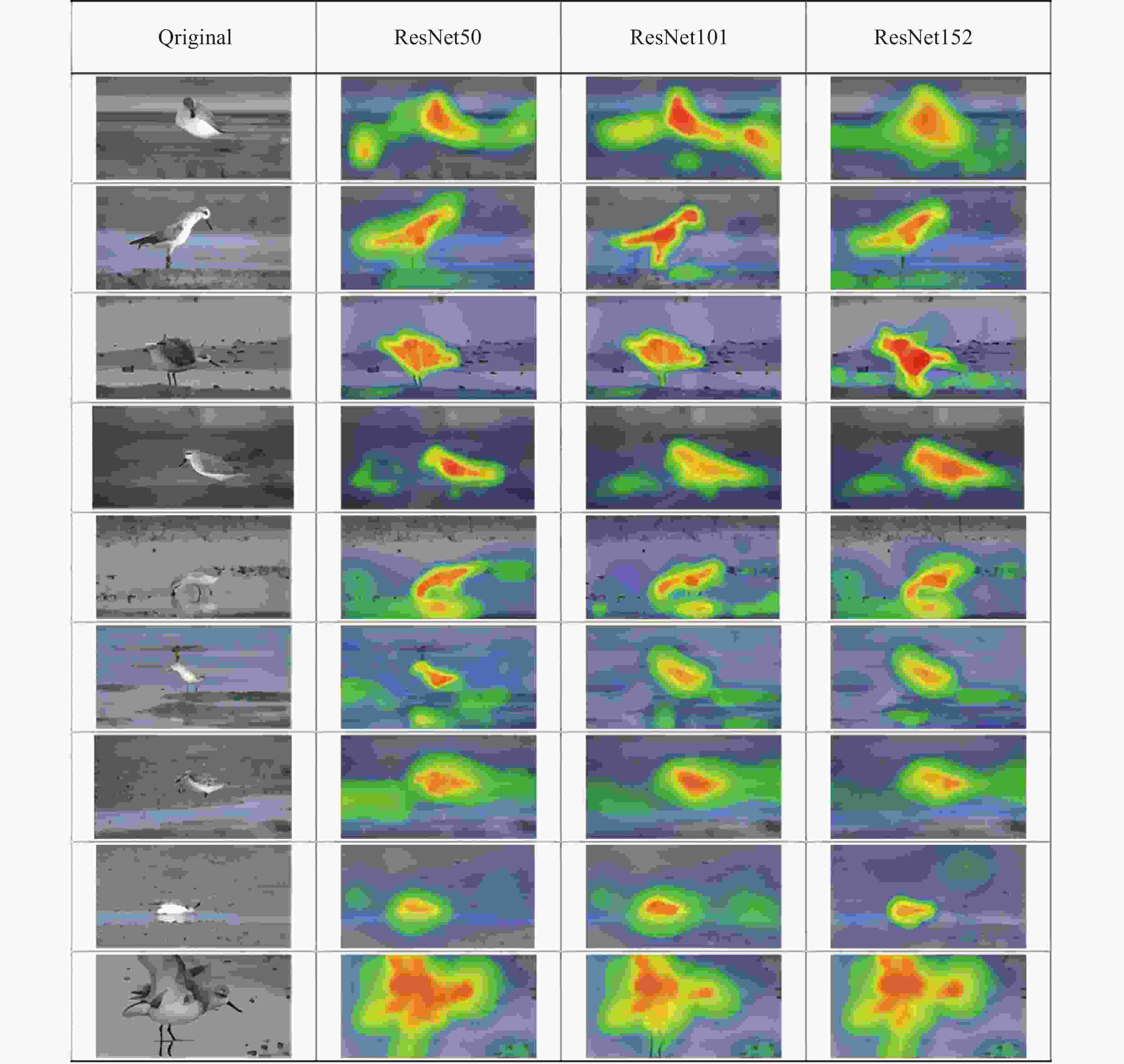

数据采集于2020-11-21—2021-03-20,采集时间段主要集中在9:00-17:30,共获得42份用相机拍摄的勺嘴鹬视频(佳能SX60HS长焦数码相机、尼康D500单反相机和尼康Z6微单相机,视频尺寸为1920×1080 30p)。将采集的数据进行预处理:1)通过查找相关文献、咨询专家和快速浏览现有视频资料确定可以用于识别勺嘴鹬动作的标签(表1);2)将42份视频数据解帧(每5秒解帧,有重复的图片只保留1张,再进行人工修正),共获得66 875张勺嘴鹬图像;3)删除勺嘴鹬与其他鸟类同框的图像和因拍摄抖动或对焦失败形成的模糊图像,手动筛选相应标签的图像(每1张图像包含1种标签),并在筛选结束后创建以标签命名的文件夹,最后共获得9个标签文件夹;4)使用Grad-Cam[33]对3种模型的预测结果进行可视化处理(图1)。图1中橙色部分表示模型是基于这些区域判断出图像中的动作类别。

动作标签 描 述 图 像 理羽 用喙部梳理、修饰身体不同部位羽毛的过程

猎食 狩猎食物的一种警戒状态,一般表现为不停转圈、直立伸长脖颈等观察食物位置的一系列动作

抖羽 使羽毛微微鼓起或竖起,抖动羽毛的过程

进食 吞咽食物的一系列动作

觅食 将喙部贴在水面或深入水下寻觅食物的过程

踱步 脖子或身子略向前倾,脚抬起往前的过程

休憩 头颈后转、喙前端埋于翅下或头颈略为回缩、闭眼静止不动的行为

洗浴 将身体浸入水中或在水体表面,通过颈部伸缩、翅膀的快速抖动及身体摆动等动作将水遍布身体,清洗身体的过程

振翅 大幅度拍打翅膀或翅膀完全张开的过程

-

由于目前没有用于识别勺嘴鹬动作的公共数据集,因此,笔者建立了1个由猎食、觅食、休憩、理羽、洗浴、抖羽、振翅和踱步9种动作标签构成的共2 174张图片的数据集(表2),该数据集按照 3∶ 1∶ 1的比例随机划为训练集、验证集和测试集[34]。

动作标签 数量/张 训练集/张 验证集/张 测试集/张 理羽 463 270 90 90 猎食 229 89 30 30 抖羽 126 74 25 25 进食 69 32 11 11 觅食 407 196 66 66 踱步 191 93 31 32 休憩 171 100 34 34 洗浴 401 240 80 81 振翅 90 52 17 18 总数 2174 1146 384 387 -

卷积神经网络包含多个卷积层、池化层和全连接层[35]。卷积层和池化层是提炼图像特征关键部分的模型,全连接层能够在高层次特征域内把图像分类作为主要实现的图像映射[36-38]。卷积神经网络也可以被认为是由特征提取器和分类器2个部分组成,具有端到端特征提取和分类的特性。在卷积神经网络的结构中,卷积的层次更深,网络学习的能力也就更强,那么特征图能得到的信息也会更全。然而,随着网络层次和结构逐渐加深,网络内的计算量也将随之增多,进而导致网络也变得更为复杂,同时可能会导致梯度消失和网络退化等问题[39],从而导致识别效果和稳定性都不理想。

残差网络(ResNet)是最近十多年以来相关领域研究人员提出的最新关于执行计算机领域视觉任务的一种典型的卷积神经网络,因其加入了残差模块从而减少了随网络深度的增加而引起的梯度消失的问题[40],一方面减少了参数数量,另一方面在网络中增加了直连通道,增加了卷积神经网络对特征的学习能力[41]。鉴于此背景,笔者使用ResNet101[42]、ResNet50[43]和ResNet152[44]3种不同层数的残差卷积网络模型作为本研究的基本网络。

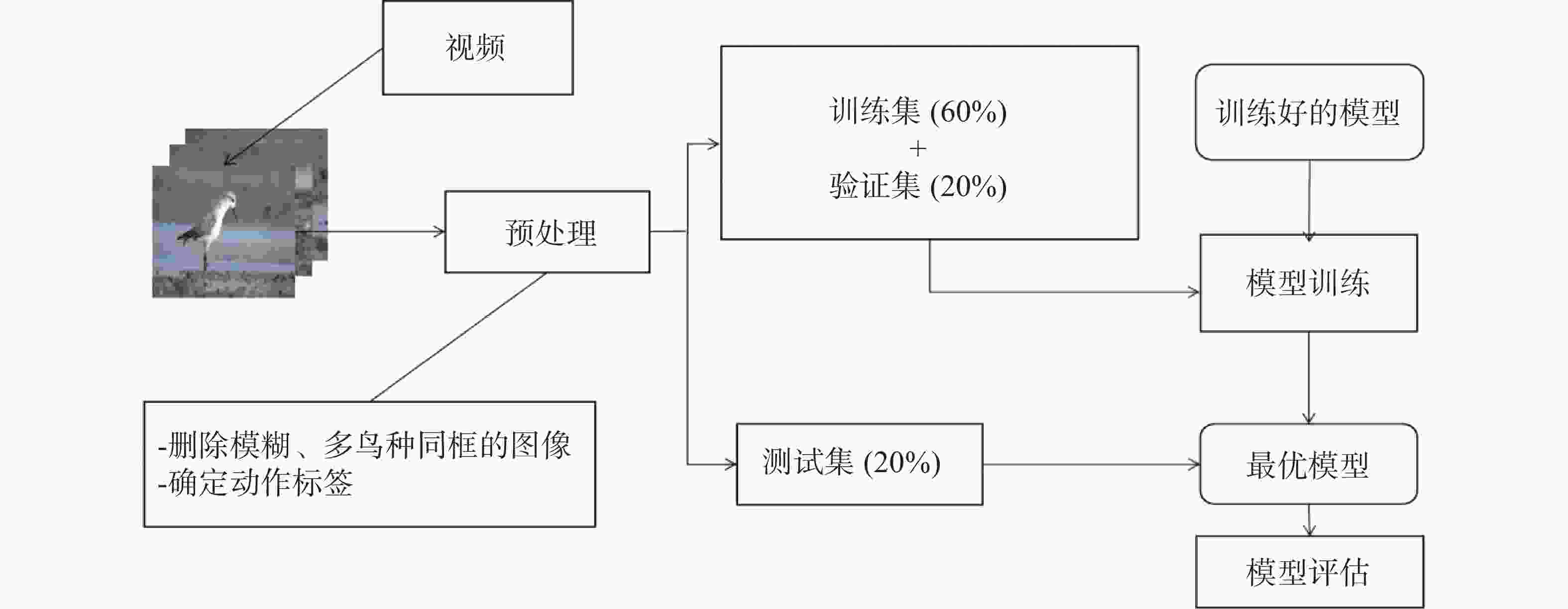

因本研究数据集的图像相对较少,所以采用残差网络迁移学习[20]的方法, 将前人训练 ImageNet 图像数据集得到的不同深度残差网络模型的模型参数当作勺嘴鹬图像训练3种网络模型的初始化值, 然后把预训练网络内的最后一层的全连接层输出替换为本研究的勺嘴鹬图像数据集的类别数9,以此为基础,再将勺嘴鹬图像识别模型进行下一步训练(图2)。

-

实验中所有代码均是在 PyTorch[45]神经网络框架下完成的。本研究选用的是PyTorch1.3.1,框架环境为GPU: Tesla V100Mem: 32 GB,操作系统是Linux Cento OS 7.2服务器。

-

本研究所用模型是以经典的ResNet50、ResNet101和ResNet152模型为基础进行新的改善,网络结构超参数具体设置分别为损失函数设置为交叉熵函数;优化器设置为自适应矩估算法;学习率设置为0.0001;训练轮数为100;批量为64。

-

本研究采用自适应矩估计(Adam)方法[46]进行模型的优化。图像分类评估中常用的评价指标有准确率(精度)、精确率、召回率和F1-score[47],在此基础上本研究添加模型训练时长作为模型的评价指标。根据真实标签和预测结果,将所有测试图像分为4类。总共有4个基本数:真阳性(TP)、真阴性(TN)、假阳性(FP)和假阴性(FN)。正确预测的测试图像的数量由TP和TN表示,错误预测的图像的数量由FN和FP表示。准确率就是正确分类样本所占总样本的比率,能够衡量分类器对于总样本的判断能力[33]。精确率又称查准率,值越高说明正确分类率越高。召回率又称查全率,值越高说明识别得越全面。F1-score表示的是算法的综合性能,可以平衡召回率和准确率的影响,其取值范围为0~1,值越大表示算法性能越好。以上评价标准形式化定义如下:

式中:阳性与阴性是相对的,若阳性代表觅食,阴性代表踱步;TP为真阳性(true positive)图像数目,真阳性则证明这个图像在整个预测分类的结果和标记标签中属于觅食;FP为假阳性(false positive)图像数目,假阳性证明此图像标记标签是觅食,但是在预测分类结果中为踱步;TN为真阴性(true negative)图像数目,真阴性证明该图像标记标签为踱步,并且对其预测的结果也属于踱步;FN(false negative)是假阴性图像数目,假阴性是图像标记标签踱步,但在预测的分类结果里是觅食[26]。

-

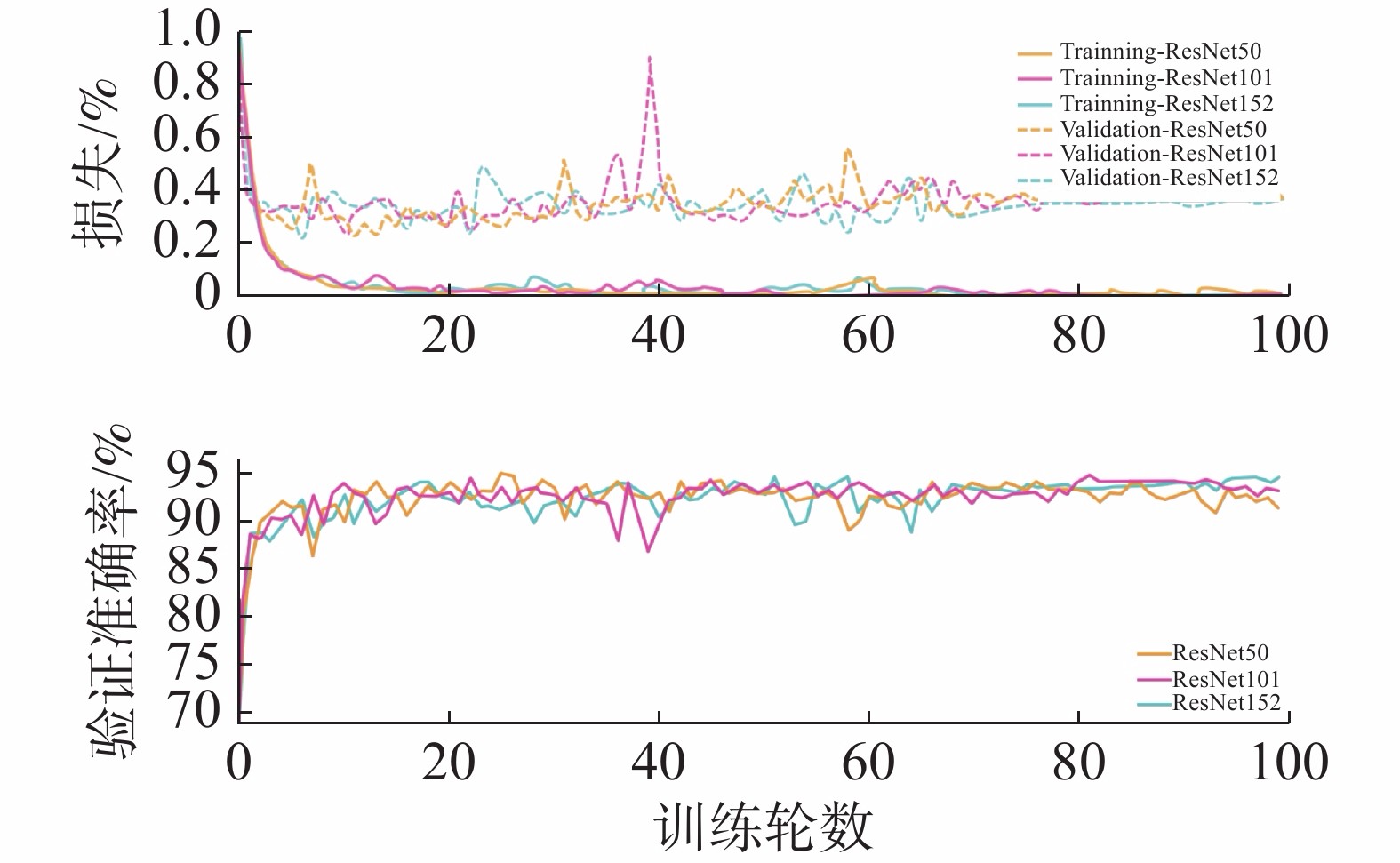

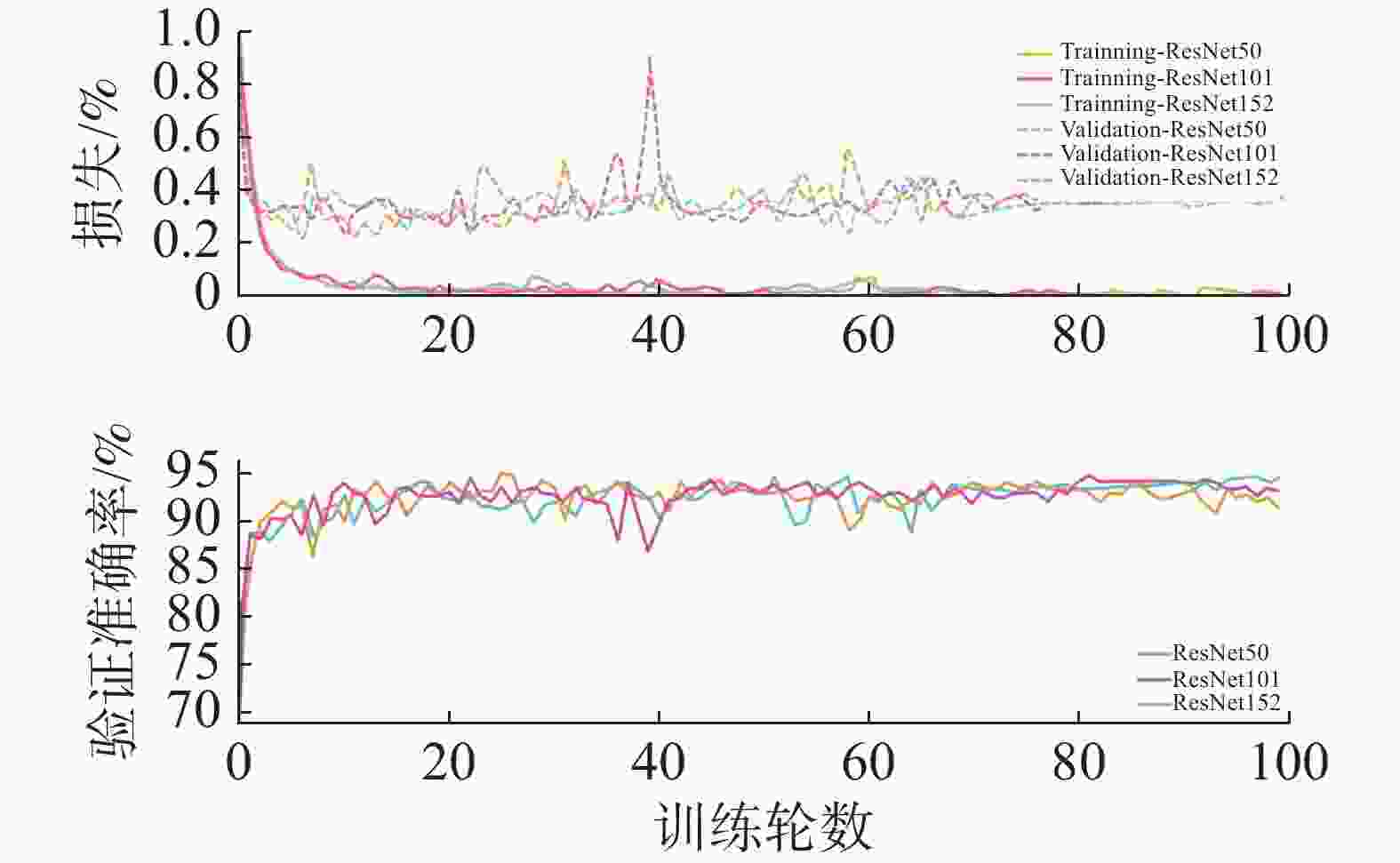

随着训练轮数的增加,每个模型的预测值与真实值之间的损失都呈下降趋势,验证集中的准确性都呈上升趋势(图3)。最后,随着训练轮数增多,每个模型的验证准确率都趋于稳定,仅存在小幅波动,这表明网络得到了充分的训练。

-

从准确率来说,3种网络模型准确率之间的差别较小,不同模型的验证集准确率和测试集准确率都在95%以上,说明模型的泛化能力良好(表3)。模型在每轮训练时长上都有较快的速度,时长由短到长依次为ResNet50、ResNet101和ResNet152,其中,ResNet50和ResNet152测试集准确率都是96.90%,ResNet101测试集准确率为96.64%,低于其他2个模型。ResNet50训练时长是89.78 s·轮,ResNet152训练时长是101.87 s·轮,在同样准确率的情况下,ResNet50训练时长低于ResNet152。

模型 训练集

准确率/%验证集

准确率/%测试集

准确率/%训练时

长/( s·轮)ResNet50 92.41 96.61 96.90 89.78 ResNet152 90.49 95.31 96.90 101.87 ResNet101 87.87 97.40 96.64 95.53 -

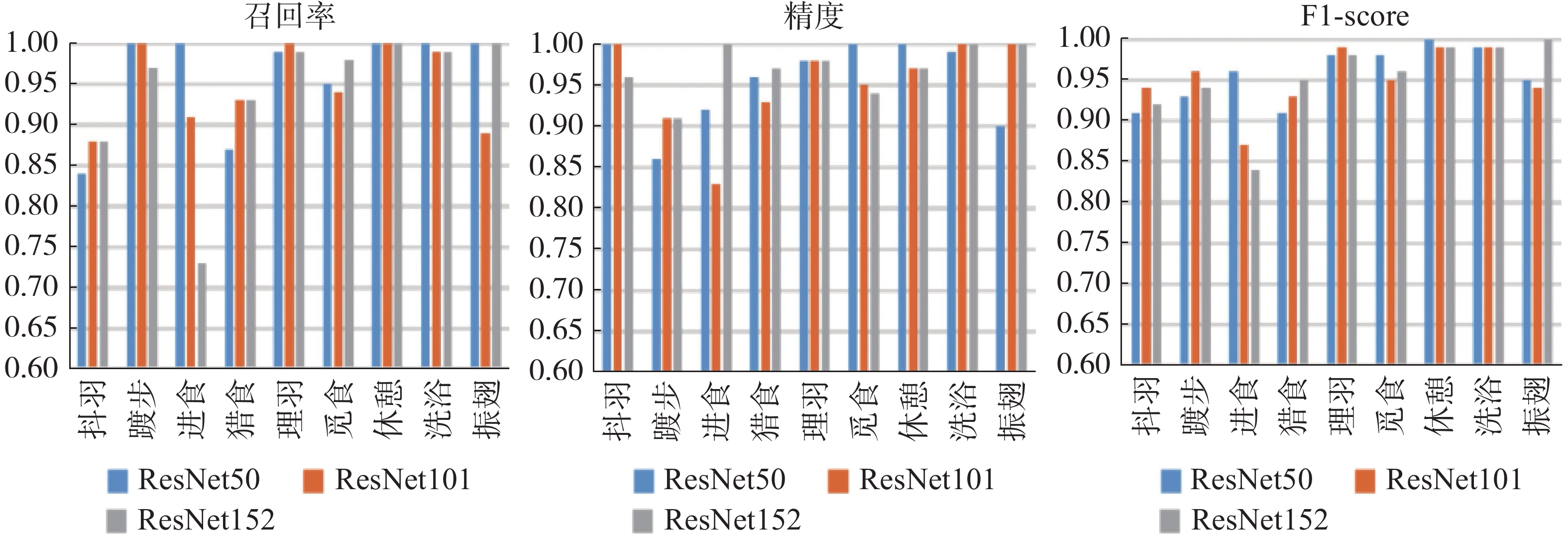

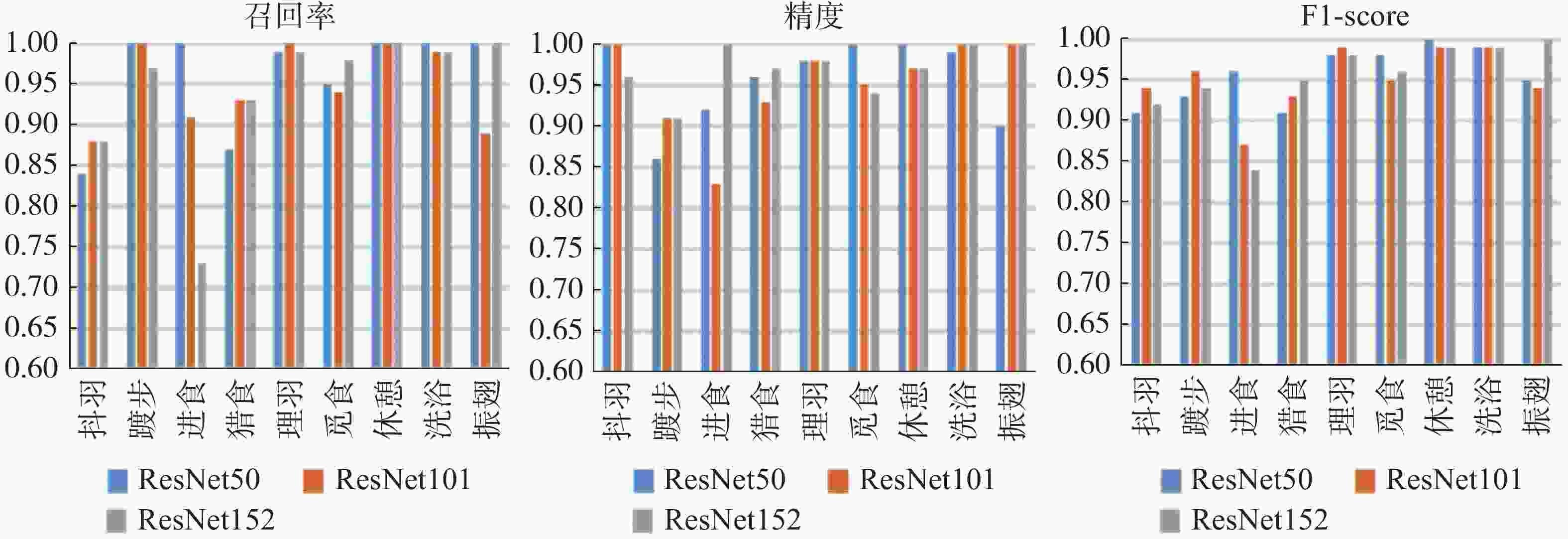

图4展示了不同模型在数据集上的评价指标结果。进食动作标签在ResNet101和ResNet152模型的F1-score值偏低于0.90,除此之外的其他动作标签在不同的模型的F1-score值都高于0.90,表明本研究算法的综合性能较好。在模型精度方面,除踱步和进食2种动作标签的精度在ResNet50和ResNet101上低于0.90,其余标签的精度都不低于0.90,说明3种模型在识别动作标签时都有较强的识别能力。在召回率方面,进食标签在ResNet152上的召回率在0.80以下,其余标签在不同的模型上召回率都在0.80以上,且大部分高于0.90,说明进食动作识别得不够全面。

-

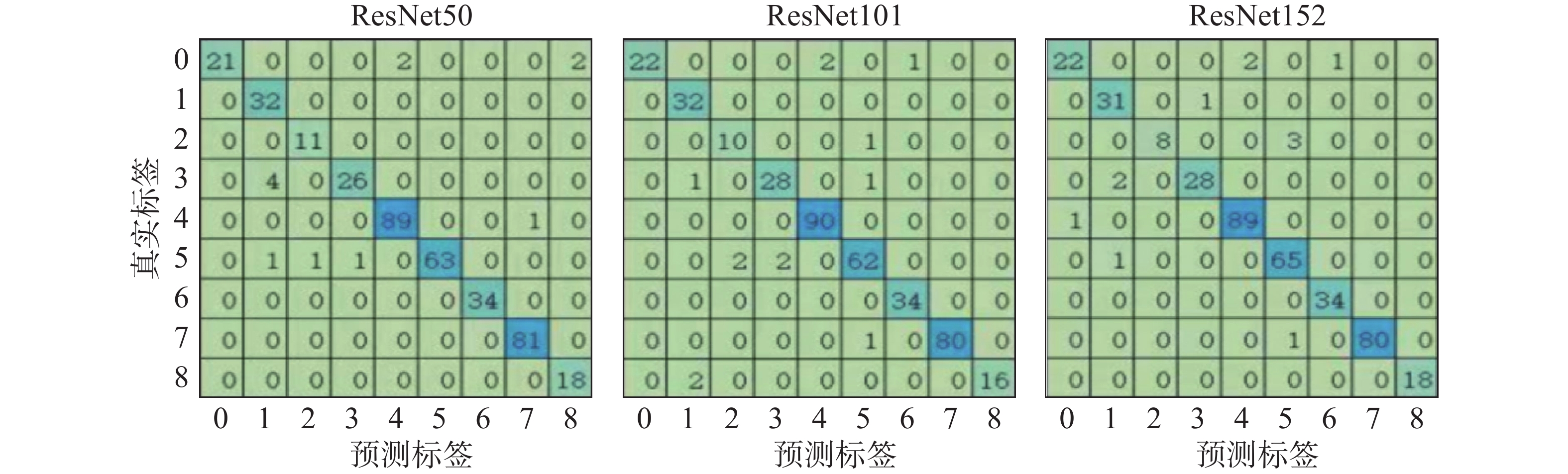

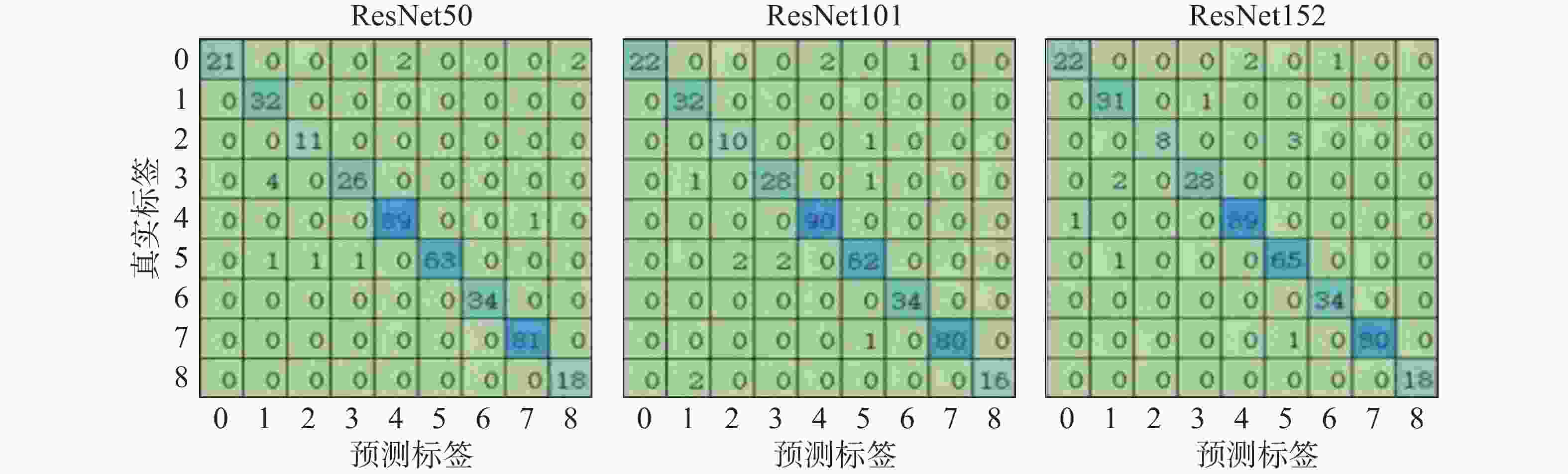

图5对角线上表示在测试集中预测正确的图像数量,其余为预测错误的数量。模型对一些动作的识别容易存在误判现象,如ResNet50模型在识别猎食和踱步时错判最多,有4张猎食被错判成踱步;ResNet101模型有2张抖羽被错判成理羽;ResNet152模型有3张进食被错判成觅食。ResNet50、ResNet101和ResNet152模型识别错误的图像总数分别是12、13、20张。

-

目前在家禽的动作和行为识别方面已经有了初步研究。劳凤丹等[48]基于人工设计的10种特征利用贝叶斯分类法对单只蛋鸡的行为进行了识别,取得了不错的结果。但文献[48]中蛋鸡的行为识别是在人工设计的特征(如蛋鸡图像的质心点坐标、轮廓面积、移动距离等)的基础上进行的,人工设计的特征往往对领域知识依赖度高,还需要大量的实验测试,可能只在特定的任务上才能获得不错的效果[49]。相比而言,本研究利用卷积神经网络实现“端到端”的方式进行勺嘴鹬动作识别,特征提取和分类过程均由模型自动完成,使用这种方法的门槛被大大降低。Wang等[11]验证了利用深度卷积神经网络从鸟类图像中识别栖息环境元素的可行性,最大识别率达到95.52%,所以笔者期望未来可以进行勺嘴鹬等稀濒危涉禽栖息地的因素识别,进一步推进栖息地选择的研究。本研究的数据集样本相对较少,只实现了9种动作识别,未实现勺嘴鹬所有可能动作的识别,期望未来可以通过补充勺嘴鹬不同动作类别的图像进一步完善勺嘴鹬的其他动作的识别研究。因鸻鹬类涉禽可能存在外观、体型或行为相似的情况(勺嘴鹬与红颈滨鹬),所以模型未来可以推广到鸻鹬类涉禽的动作识别,进一步推动有关濒危珍稀涉禽的保护研究。

本研究的不足主要有两个。第一,只进行勺嘴鹬的动作研究,所以模型在识别与勺嘴鹬体型、行为等方面差异较大的鸟类时,识别效果可能不大理想。此外,因一些不可避免的环境因素和人为因素,采集的视频数据主要集中在光线较好的9:00-17:30,所以模型可能更适用于在光线良好时间段拍摄图像的识别。本研究中踱步和进食的识别精度低于其他动作的主要原因是数据量不够充足,导致识别某几个标签的时候容易混淆,而且因为静态图像识别动作的缺陷,导致踱步和进食的识别较差,笔者会在后续工作中进行数据补充。第二,使用的是单标签方法来标记勺嘴鹬的动作,而在实际应用时可能会出现1张图像有多标签、部分分类照片较少的情况,迁徙候鸟具有显著的集群行为[50],此类研究往往需要识别1张图像中不同鸟种的不同动作。如果未来通过结合目标检测、图像分割和物种识别等技术,把一群鸟转换成单只鸟进行识别,实现从多种鸟同框的图片中识别出多个不同的动作并用一个框将每个动作分割出来,进一步再通过采集更多的图像数据进行训练,可以使训练模型在实际应用时具有更强的适应性。

致谢:新英湾红树林保护区陈正平同志和中国热带农业科学院橡胶研究所杨川助理研究员对本研究的野外工作提供了大力的支持,在此深表感谢!

Action recognition of spoon-billed sandpipers (Eurynorhynchus pygmeus) based on residual convolutional neural network model

DOI: 10.15886/j.cnki.rdswxb.20220088

- Received Date: 2022-10-22

- Accepted Date: 2023-02-24

- Rev Recd Date: 2023-01-24

- Available Online: 2023-04-27

- Publish Date: 2023-09-25

-

Key words:

- residual convolutional neural network /

- bird image /

- movement recognition /

- spoon-billed sandpiper

Abstract: With the widespread application of image acquisition equipment and data sharing platform, the amount of bird image data has been increasing at an unprecedented speed. How to effectively deal with such a large amount of data has become a major challenge. In recent years, convolutional neural network has shown strong practicability and effectiveness in the application of automatic bird image processing. However, there has been no research on automatic recognition of movements in wild birds. In view of this, a special action image dataset of the sandpiper was established based on field images. The dataset was composed of nine action tags representing the main behavior patterns of spoon-billed sandpipers (Eurynorhynchus pygmeus). At the same time, three residual convolutional neural network models, ResNet50, ResNetT101 and ResNet152, were used to automatically recognize the movements of the spoon-billed sandpipers. The experimental results showed that the three models achieved excellent results in action recognition with their accuracy rates of the test set being 96.90% (ResNet50), 96.94%(ResNet101) and 96.90% (ResNet152), respectively. This indicates that these three models have a rapid recognition of the movements of the spoon-billed sandpiper.

| Citation: | YANG Xueke, MENG Jinchao, FENG Yueheng, LIN Tingting, WANG Zhaojun, LIU Hui. Action recognition of spoon-billed sandpipers (Eurynorhynchus pygmeus) based on residual convolutional neural network model[J]. Journal of Tropical Biology, 2023, 14(5): 481-489. doi: 10.15886/j.cnki.rdswxb.20220088 |

DownLoad:

DownLoad: